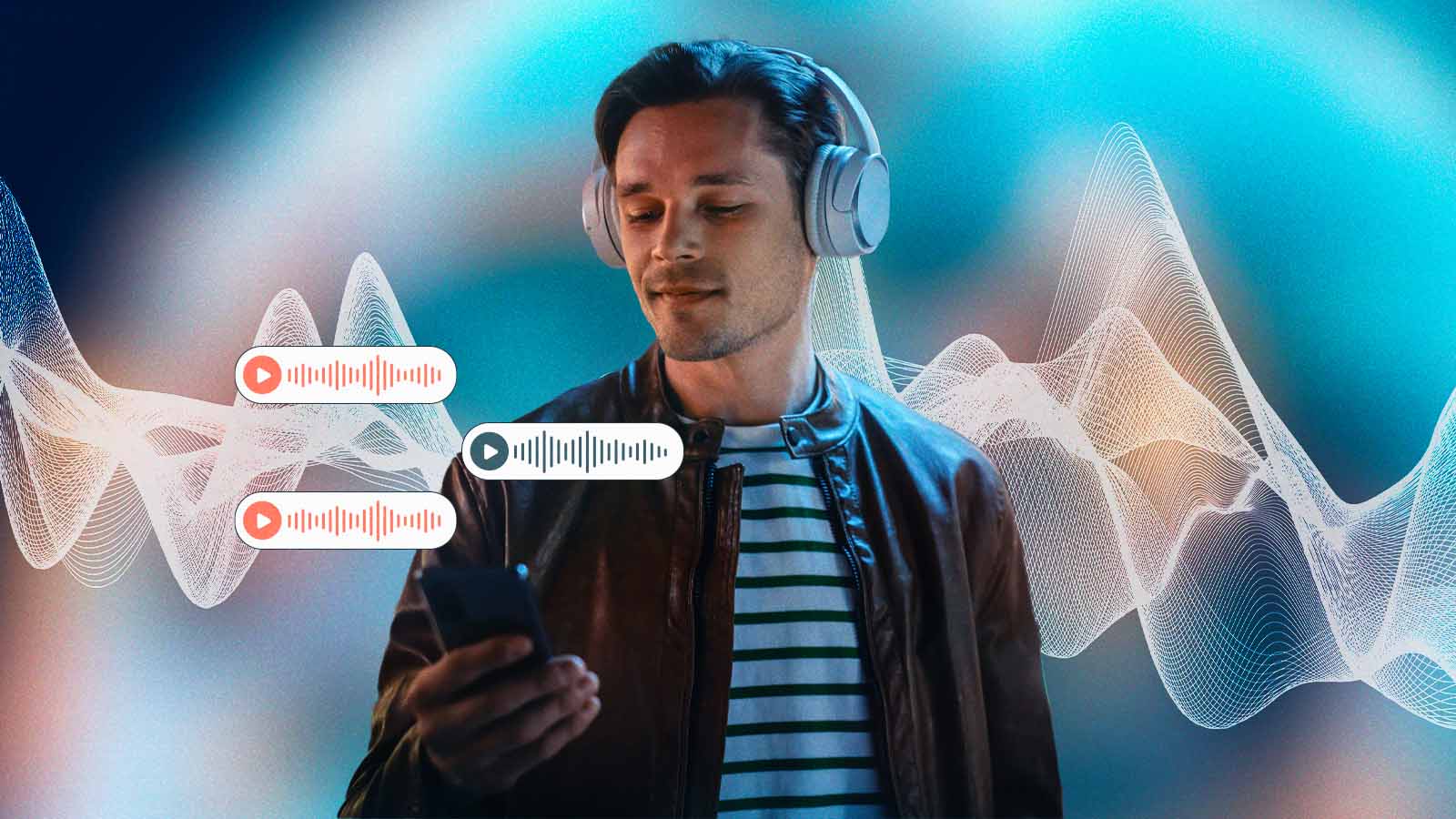

Seu áudio foi clonado? A pergunta sobre o que são deepfakes de áudio te assombra? Pode confessar, a tecnologia assusta quando alguém fala com a voz do seu chefe pedindo dinheiro ou de um político dizendo algo que ele nunca disse. A gente sabe, é um pesadelo real em 2026. Mas calma, estamos aqui para desmistificar tudo e te mostrar como se defender dessa onda.

Este guia completo vai te tirar do escuro e te dar o poder de identificar e se proteger dos deepfakes de áudio. Vamos lá?

Entenda como a Inteligência Artificial Clona Vozes para Criar Deepfakes de Áudio em 2026

A verdade é que os deepfakes de áudio nascem da combinação poderosa entre ‘deep learning’ (aprendizado profundo) e a palavra ‘fake’. Algoritmos superinteligentes analisam milhares de horas da voz de uma pessoa, aprendendo cada nuance: o tom, a cadência, as pausas, tudo.

Com essa ‘assinatura vocal’ em mãos, a IA consegue gerar falas totalmente novas, impossíveis de distinguir da voz original para a maioria dos ouvidos. É a clonagem de voz por IA em seu estado mais avançado e perigoso.

“Deepfakes de áudio, também conhecidos como clonagem de voz, são arquivos de som gerados ou manipulados por inteligência artificial (IA) para simular com extrema precisão a voz de uma pessoa real, utilizando algoritmos de aprendizado de máquina para analisar padrões de fala, entonação e sotaque.”

O Que São Deepfakes de Áudio em 2026 e Para Que Servem?

Pode confessar: a gente vive num mundo onde a tecnologia avança a passos largos e, às vezes, parece que estamos em um filme de ficção científica. E quando o assunto são os deepfakes de áudio, essa sensação só aumenta. Basicamente, estamos falando de uma manipulação digital que usa inteligência artificial para criar ou alterar gravações de voz, fazendo parecer que alguém disse algo que, na verdade, nunca falou.

A verdade é que essa tecnologia, que combina algoritmos de deep learning com a ideia de manipulação (‘fake’), já não é novidade, mas em 2026, ela atingiu um nível de sofisticação assustador. A capacidade de simular a voz de qualquer pessoa, com entonação e sotaque perfeitos, abre um leque de possibilidades, tanto para o bem quanto para o mal. Vamos entender isso a fundo?

| Característica | Descrição |

| Tecnologia Base | Algoritmos de deep learning |

| Funcionalidade Principal | Criação e manipulação de áudio para simular vozes reais |

| Técnica Associada | Clonagem de voz por IA |

| Riscos Notórios | Golpes financeiros, desinformação em eleições |

| Identificação | Tom artificial, qualidade inconsistente, contexto suspeito |

| Legislação Brasileira | Proibição em propagandas eleitorais (TSE) |

| Aplicações Legítimas | Indústria do entretenimento (dublagem, restauração de voz) |

| Ameaça à Segurança | Cibersegurança, criação de áudios falsos |

O que são Deepfakes de Áudio e Clonagem de Voz?

Vamos direto ao ponto: deepfakes de áudio são gravações sonoras que foram artificialmente geradas ou alteradas por IA. Pense nisso como um Photoshop para a sua voz. A técnica mais comum por trás disso é a clonagem de voz por IA, onde a inteligência artificial aprende as características únicas da voz de uma pessoa – o tom, o ritmo, as inflexões – a partir de amostras de áudio. Com um volume razoável de dados, a IA consegue replicar essa voz com uma precisão impressionante.

O resultado? Um áudio que soa indistinguível da voz original, permitindo que criminosos ou mal-intencionados façam com que a pessoa ‘diga’ qualquer coisa. Isso vai desde mensagens pessoais até declarações públicas que nunca foram feitas. É a tecnologia a serviço da ilusão sonora, e o potencial para engano é enorme.

Como a Tecnologia Deepfake de Áudio Funciona?

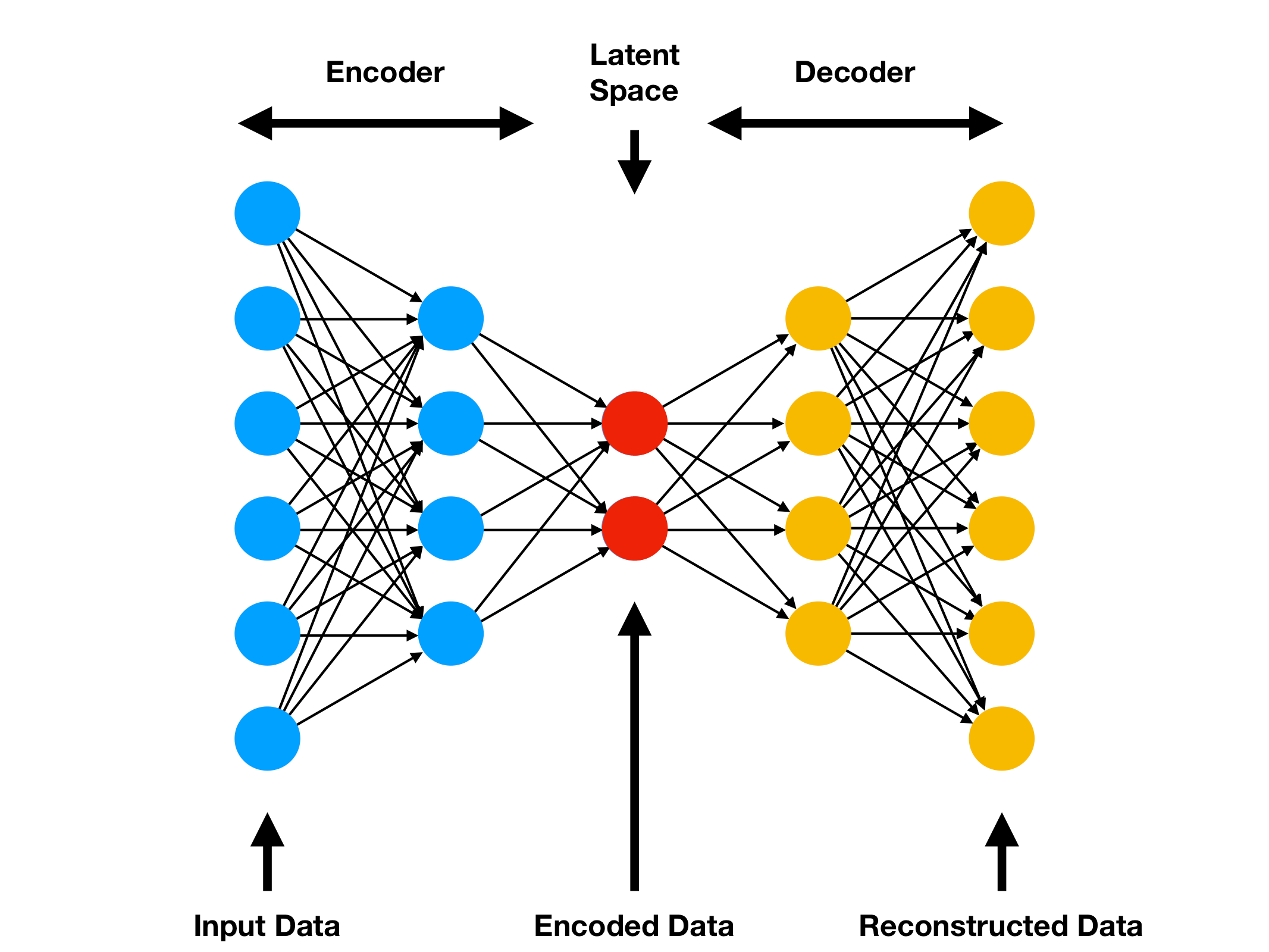

A mágica – ou o pesadelo, dependendo do ponto de vista – por trás dos deepfakes de áudio está nos algoritmos de deep learning. Esses sistemas são treinados com enormes quantidades de dados de áudio de uma pessoa específica. Quanto mais dados, mais fiel será a reprodução.

O processo geralmente envolve redes neurais, como as redes generativas adversariais (GANs) ou modelos de sequenciamento de áudio. Uma parte da rede aprende a gerar a voz (o ‘gerador’), enquanto outra parte tenta distinguir entre o áudio real e o gerado (o ‘discriminador’). Essa ‘competição’ faz com que o gerador fique cada vez melhor em criar áudios que enganem o discriminador – e, consequentemente, a nós.

A capacidade de gerar áudio sintético de alta qualidade democratizou a criação de conteúdo, mas também as ferramentas para a desinformação em massa.

É um ciclo de aprendizado contínuo que resulta em vozes sintéticas incrivelmente realistas. A qualidade do áudio final depende muito da quantidade e qualidade dos dados de treinamento, mas os avanços recentes tornaram isso acessível até mesmo para quem não é um expert em IA.

Principais Usos Legítimos dos Deepfakes de Áudio

Olha só, nem tudo é trevas nesse universo. A tecnologia de clonagem de voz e geração de áudio tem aplicações incríveis e muito úteis. Na indústria do entretenimento, por exemplo, as aplicações de IA na indústria do entretenimento estão revolucionando a forma como filmes e jogos são produzidos. Imagine restaurar a voz de um ator falecido para uma nova cena, ou dublar um filme em vários idiomas com a voz original do ator, mas no idioma local. Isso já é realidade!

Outros usos incluem:

- Criação de assistentes de voz com vozes personalizadas e mais naturais.

- Produção de audiolivros com narrações perfeitas.

- Ferramentas para pessoas com dificuldades de fala se comunicarem com sua própria voz clonada.

- Personalização de experiências em call centers e atendimento ao cliente.

- Efeitos sonoros e narrações em podcasts e vídeos.

- Jogos de videogame com personagens que respondem de forma mais dinâmica.

- Simulações de treinamento para profissionais (ex: médicos, policiais).

- Criação de conteúdo educacional mais envolvente.

- Sistemas de acessibilidade para deficientes visuais.

- Restauração de gravações antigas com baixa qualidade.

- Personalização de mensagens de marketing.

- Criação de personagens virtuais em metaversos.

- Ferramentas para criadores de conteúdo em redes sociais.

- Produção de locuções para publicidade.

- Sistemas de navegação GPS com vozes personalizadas.

- Experiências interativas em museus e exposições.

- Criação de trilhas sonoras e efeitos para animações.

- Desenvolvimento de ferramentas de aprendizado de idiomas.

- Geração de vozes para personagens de animação.

- Simulações de voz para testes de software de reconhecimento vocal.

- Criação de conteúdo para realidade virtual.

- Personalização de alarmes e notificações.

- Ferramentas para compositores e produtores musicais.

- Dublagem de vídeos para plataformas de streaming.

- Criação de jingles e vinhetas personalizadas.

- Narração de documentários.

- Produção de audio dramas.

- Personificação de avatares em transmissões ao vivo.

- Geração de locuções para apresentações corporativas.

- Ferramentas para criação de roteiros de áudio.

- Simulação de vozes para fins de pesquisa científica.

- Criação de mensagens de áudio personalizadas para eventos.

- Desenvolvimento de assistentes virtuais para empresas.

- Produção de narrações para cursos online.

- Criação de efeitos sonoros para jogos de tabuleiro.

- Personalização de sistemas de automação residencial.

- Geração de vozes para chatbots avançados.

- Narração de notícias em tempo real.

- Criação de vinhetas para rádios e podcasts.

- Ferramentas para artistas musicais experimentais.

- Simulação de vozes para fins de terapia.

- Produção de conteúdo para redes sociais de áudio.

- Criação de mensagens de boas-vindas personalizadas.

- Desenvolvimento de sistemas de reconhecimento de voz para crianças.

- Geração de narrações para e-books.

- Ferramentas para criação de efeitos sonoros em filmes.

- Criação de áudios interativos para marketing.

- Personalização de sistemas de alerta de segurança.

- Produção de narrações para vídeos explicativos.

- Criação de vinhetas temáticas para eventos.

- Desenvolvimento de assistentes de voz para acessibilidade.

- Geração de vozes para personagens de audio dramas.

- Ferramentas para criação de trilhas sonoras originais.

- Criação de áudios para campanhas de conscientização.

- Personalização de sistemas de entretenimento em veículos.

- Produção de narrações para apresentações de slides.

- Criação de vinhetas para programas de TV.

- Desenvolvimento de assistentes virtuais para idosos.

- Geração de vozes para personagens de jogos de tabuleiro.

- Ferramentas para criação de efeitos sonoros para animações curtas.

- Criação de áudios para experiências imersivas.

- Personalização de sistemas de comunicação interna em empresas.

- Produção de narrações para materiais de treinamento.

- Criação de vinhetas para comerciais de rádio.

- Desenvolvimento de assistentes virtuais para estudantes.

- Geração de vozes para personagens de curtas-metragens.

- Ferramentas para criação de narrações dinâmicas.

- Criação de áudios para campanhas publicitárias.

- Personalização de sistemas de entretenimento doméstico.

- Produção de narrações para apresentações de negócios.

- Criação de vinhetas para programas de rádio.

- Desenvolvimento de assistentes virtuais para profissionais de saúde.

- Geração de vozes para personagens de web séries.

- Ferramentas para criação de efeitos sonoros para vídeos curtos.

- Criação de áudios para experiências de aprendizado.

- Personalização de sistemas de comunicação em eventos.

- Produção de narrações para manuais digitais.

- Criação de vinhetas para anúncios de TV.

- Desenvolvimento de assistentes virtuais para designers.

- Geração de vozes para personagens de animações curtas.

Os Maiores Riscos e Perigos da Clonagem de Voz por IA

Agora, a parte que nos tira o sono. A mesma tecnologia que pode ser usada para criar conteúdo incrível também é uma ferramenta poderosa nas mãos de criminosos. Os riscos de deepfake financeiro são alarmantes: bandidos clonam a voz de executivos ou familiares para enganar pessoas e solicitar transferências de dinheiro urgentes. Um telefonema convincente pode fazer você perder suas economias em minutos.

Além disso, a desinformação em eleições é um campo fértil para os deepfakes. Imagine um candidato ‘dizendo’ algo escandaloso dias antes da votação, manipulando a opinião pública e influenciando o resultado. A segurança cibernética e deepfakes se tornaram áreas de atenção máxima justamente por causa desse potencial destrutivo.

A linha entre o real e o falso está cada vez mais tênue, e a vigilância é nossa primeira linha de defesa.

O perigo reside na capacidade de gerar confiança através de uma voz familiar. A manipulação psicológica é imensa, pois tendemos a acreditar no que ouvimos de pessoas conhecidas ou de figuras de autoridade.

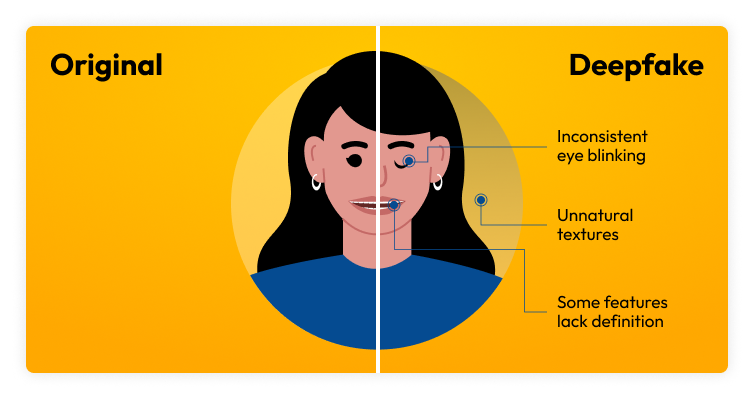

Como Identificar um Áudio Falso: Sinais e Dicas

Saber como identificar áudios falsos de IA é crucial no nosso dia a dia. A boa notícia é que, embora a tecnologia esteja avançada, ainda existem sinais. Preste atenção ao tom de voz artificial: às vezes soa um pouco robótico, sem as nuances naturais da fala humana. A qualidade inconsistente também é um alerta – pode haver ruídos estranhos, falhas na gravação ou um volume que varia de forma incomum.

Fique atento ao contexto suspeito. Se um áudio parece bom demais para ser verdade, ou se a mensagem pede algo urgente e incomum, desconfie. Pergunte-se: essa pessoa falaria exatamente assim? A situação faz sentido? Além disso, a tecnologia ainda pode ter dificuldade em replicar emoções complexas ou respirações naturais em momentos de fala.

Deepfakes e a Legislação: O Caso do TSE no Brasil

No Brasil, o Tribunal Superior Eleitoral (TSE) já se movimentou para coibir o uso indevido dessa tecnologia. A legislação deepfake TSE proibiu explicitamente o uso de deepfakes em propagandas eleitorais. Isso mostra a preocupação das autoridades com o impacto que essas manipulações podem ter no processo democrático.

A ideia é clara: proteger a integridade das eleições e garantir que a opinião pública não seja moldada por mentiras criadas digitalmente. A decisão do TSE é um passo importante, mas a discussão sobre a regulamentação de deepfakes em outras esferas da sociedade ainda está em andamento.

A legislação precisa acompanhar o ritmo da tecnologia para garantir um ambiente digital mais seguro e confiável.

É fundamental que a sociedade esteja ciente desses riscos e que as leis se adaptem para punir o uso malicioso de deepfakes, protegendo os cidadãos e as instituições democráticas.

Aplicações Maliciosas: Golpes Financeiros e Desinformação Política

Quando falamos de o que é deepfake de áudio e como funciona, é impossível ignorar o lado sombrio. Os exemplos de deepfake de voz e seus perigos são assustadores. Um golpe comum envolve a clonagem da voz de um familiar pedindo dinheiro em uma emergência. A vítima, acreditando estar falando com um ente querido, realiza a transferência rapidamente, sem questionar.

Na esfera política, os deepfakes são usados para espalhar desinformação em eleições. Um áudio falso de um candidato pode manchar sua reputação, criar pânico ou influenciar o voto de eleitores desavisados. A capacidade de criar narrativas falsas convincentes é uma ameaça direta à democracia e à estabilidade social.

Protegendo-se Contra Deepfakes de Áudio: Medidas de Segurança

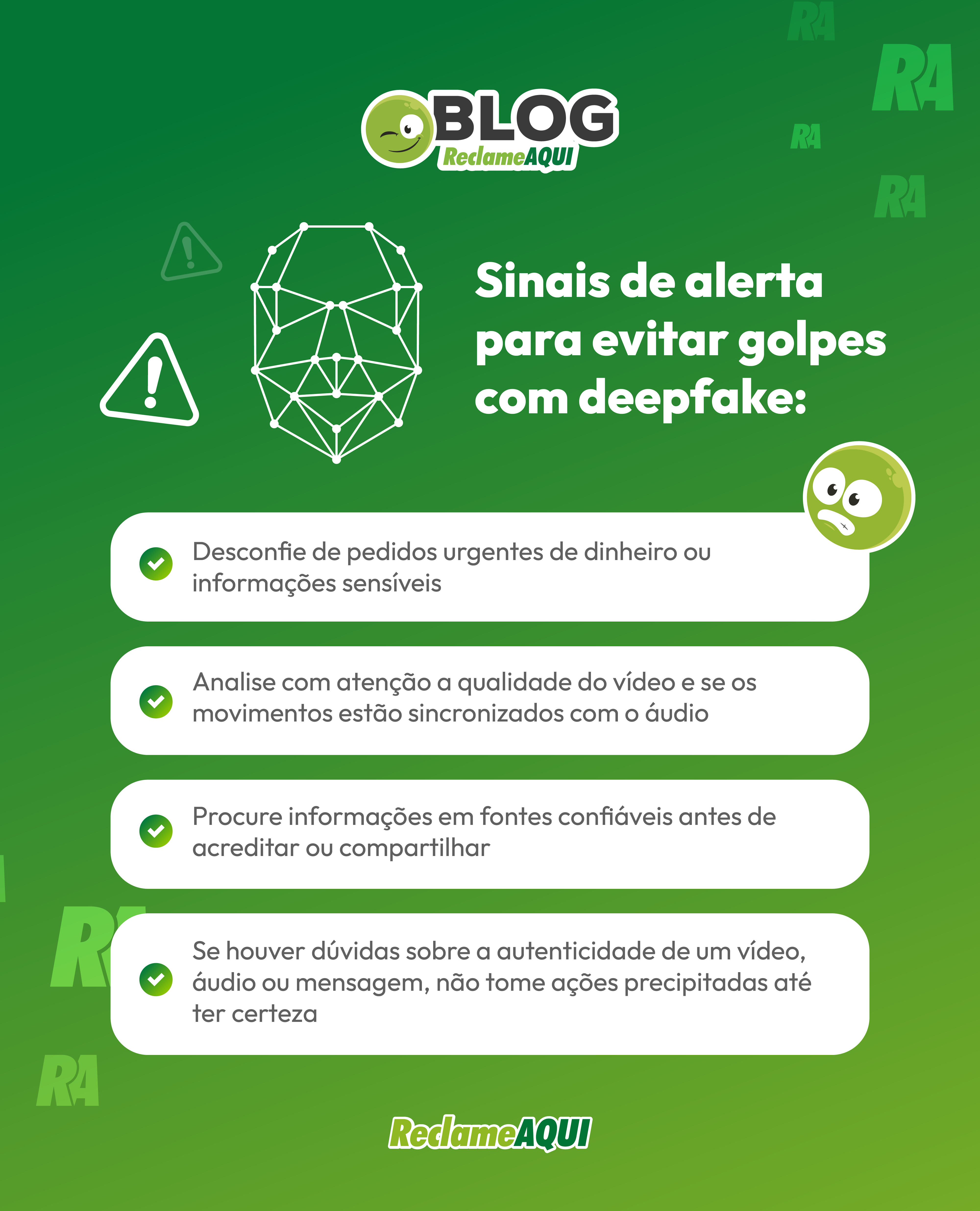

A melhor defesa contra os deepfakes de áudio é a informação e a desconfiança saudável. Primeiro, sempre desconfie de pedidos urgentes de dinheiro, especialmente se feitos por telefone e com uma história que parece fora do comum. Tente confirmar a identidade da pessoa por outro canal de comunicação – ligue de volta para um número conhecido ou pergunte algo que só o verdadeiro interlocutor saberia.

Para identificar áudios suspeitos, fique atento a:

- Falas com ritmo ou entonação estranha.

- Ausência de respirações naturais.

- Palavras ou frases repetidas de forma não natural.

- Ruídos de fundo inconsistentes ou ausentes.

- Qualidade de áudio que muda abruptamente.

- Emoções que não condizem com o contexto.

Ferramentas de detecção de deepfake estão sendo desenvolvidas, mas, por enquanto, o bom e velho senso crítico é seu maior aliado. Mantenha seus dispositivos atualizados e use senhas fortes, pois a segurança cibernética é um pilar na prevenção de ataques que podem usar deepfakes.

2026: Estamos Prontos Para o Futuro dos Deepfakes de Áudio?

A verdade é que os deepfakes de áudio vieram para ficar. A tecnologia continuará evoluindo, tornando a detecção cada vez mais desafiadora. Em 2026, a batalha contra a desinformação e os golpes baseados em áudio falso exige uma postura proativa de todos nós.

O veredito? A tecnologia em si não é boa nem má; o que importa é como ela é usada. Os usos legítimos são promissores e podem trazer muitos benefícios. No entanto, os riscos são reais e exigem atenção constante. Precisamos de legislação robusta, ferramentas de detecção eficazes e, acima de tudo, de uma população informada e cética.

Vale a pena se aprofundar no assunto? Com certeza. Estar preparado é o primeiro passo para navegar nesse novo cenário com segurança e discernimento. O futuro da comunicação é fascinante, mas também exige responsabilidade.

Dicas Extras para Ficar um Passo à Frente

- Fique Atento aos Detalhes: Na hora de ouvir um áudio, preste atenção em pausas estranhas, respirações fora de hora ou um tom de voz que parece ligeiramente robótico. A consistência é a chave.

- Desconfie de Pedidos Urgentes: Criminosos adoram criar um senso de urgência, especialmente em pedidos de dinheiro. Se receber uma ligação suspeita pedindo transferência, confirme a identidade da pessoa por outro canal.

- Use Ferramentas de Verificação: A tecnologia avança rápido, e já existem ferramentas que ajudam a identificar áudios falsos de IA. Pesquise sobre elas e tenha-as à mão.

- Eduque sua Rede: Compartilhe informações sobre deepfakes de áudio com amigos e familiares. Quanto mais pessoas informadas, menor o alcance dessas fraudes.

FAQ: Suas Dúvidas Sobre Deepfakes de Áudio Respondidas

O que é deepfake de áudio e como funciona?

Deepfake de áudio é uma tecnologia que usa inteligência artificial, especificamente algoritmos de deep learning, para criar áudios falsos que imitam perfeitamente a voz de uma pessoa. Basicamente, a IA aprende os padrões da voz original e consegue gerar novas falas com ela.

Quais são os principais riscos da clonagem de voz por inteligência artificial?

Os riscos são muitos, indo desde golpes financeiros onde criminosos pedem dinheiro se passando por conhecidos, até a disseminação de desinformação em eleições, com a criação de declarações falsas de políticos para manipular a opinião pública.

Como identificar áudios falsos de IA?

Preste atenção em inconsistências na qualidade do áudio, tom de voz artificial, pausas estranhas ou respirações fora do comum. O contexto da conversa também pode ser um grande indicativo de algo suspeito.

O deepfake de voz já é uma realidade no Brasil?

Sim, infelizmente. Já existem casos de deepfakes de voz sendo usados para aplicar golpes e, no contexto eleitoral, o Tribunal Superior Eleitoral (TSE) já proibiu o uso de deepfakes em propagandas para coibir a desinformação.

Existem exemplos de deepfake de voz e seus perigos?

Com certeza. Um exemplo clássico é a clonagem de voz para fraudes financeiras, onde um golpista liga para uma vítima simulando a voz de um familiar pedindo dinheiro. Outro perigo é a criação de áudios falsos de candidatos para difamá-los em período eleitoral.

O Futuro é Agora: Proteja-se Contra os Deepfakes de Áudio

A verdade é que os deepfakes de áudio vieram para ficar e representam um desafio crescente, especialmente com a rápida evolução da inteligência artificial. A clonagem de voz por inteligência artificial abre portas para golpes financeiros e para a disseminação de desinformação em eleições. A boa notícia é que, com informação e atenção, podemos nos defender. Ficar atento aos detalhes, desconfiar de pedidos urgentes e educar quem está ao nosso redor são passos cruciais. Lembre-se: a tecnologia pode criar o falso, mas nossa capacidade de discernimento é a melhor defesa. Esteja um passo à frente!

![O que são deepfakes de áudio: Ameaças e Defesas em 2026 [Alerta] O que são deepfakes de áudio: Ameaças e Defesas em 2026 [Alerta]](https://noticiasvaledoitajai.com.br/wp-content/uploads/2026/03/o-que-sao-deepfakes-de-audio-1024x585.webp)